Seedance 2.0 是字节跳动推出的新一代多模态视频生成模型,现已在 ComfyUI 中上线。它将文本、图像、视频和音频作为统一输入,一站式生成带有同步音频、稳定角色和电影级摄像机运动的高质量视频。Documentation Index

Fetch the complete documentation index at: https://dripart-mintlify-e28287af.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

核心能力

- 多模态输入 — 文本 + 图片/视频/音频

- 音画同步 — 视频与音频一体生成

- 运镜可控 — 可控镜头与节奏

- 一致性 — 人物与场景在整段视频中稳定

- 编辑与扩展 — 可编辑已有视频或延长片段

可用工作流

文本生成视频(T2V)

仅使用文本提示生成视频,由 Seedance 2.0 负责场景、运动与节奏的整体呈现。在云端运行 文本生成视频(T2V)

在 Comfy Cloud 上直接体验 Text-to-Video 工作流。

下载 文本生成视频(T2V)工作流

下载工作流 JSON。

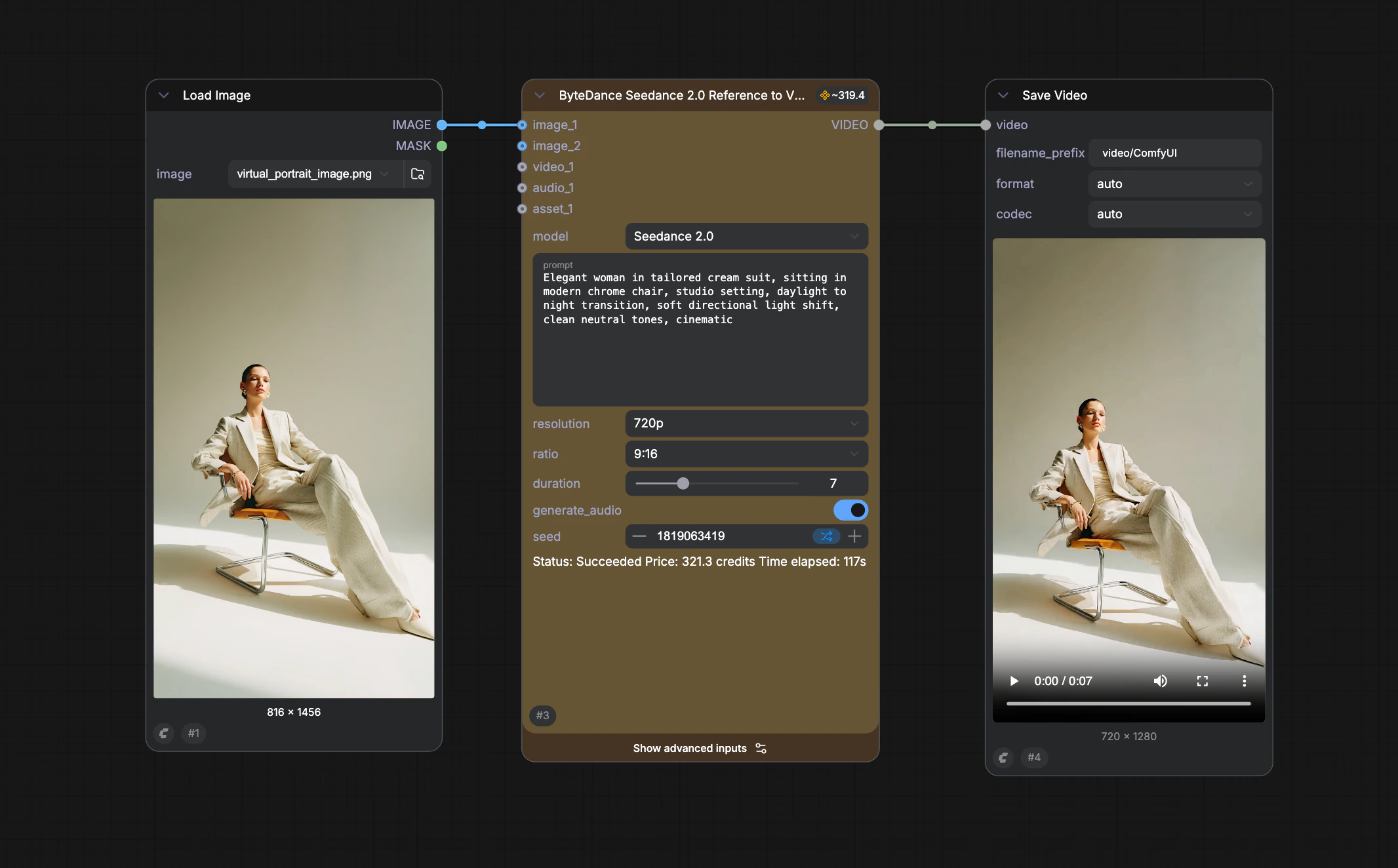

参考生成视频(R2V)

使用参考图片、视频或音频来引导外观、运动与节奏,生成结果在人物/物体与风格上保持一致。在云端运行 参考生成视频(R2V)

在 Comfy Cloud 上直接体验 Reference-to-Video 工作流。

下载 参考生成视频(R2V)工作流

下载工作流 JSON。

首尾帧生成视频(FLF2V)

提供起始帧与结束帧,由 Seedance 2.0 生成中间的运动与过渡。在云端运行 首尾帧生成视频(FLF2V)

在 Comfy Cloud 上直接体验 First-Last-Frame-to-Video 工作流。

下载 首尾帧生成视频(FLF2V)工作流

下载工作流 JSON。

在 ComfyUI 中使用真人肖像与 AI 生成肖像进行 Seedance 2.0 视频生成

Seedance 2.0 同时支持以 真人肖像 与 AI 生成肖像 作为人物参考:前者指向真实人物的影像素材,后者是画面中的虚构角色(由 AI 生成、不对应现实某人)。你走哪一类,决定了是否需要字节跳动侧的活体验证与身份核验流程。| AI 生成肖像 | 真人肖像 | |

|---|---|---|

| 指什么 | 画面表现的是 AI 合成的角色,不要求对应真实自然人 | 使用真实自然人的人像 / 出镜素材 |

| 身份验证 | 不需要额外核验 | 需要完成一次字节跳动活体检测(通过 ByteDance Create Image/Video Asset 流程) |

| 工作流 | 任选标准 Seedance 2.0 工作流(T2V、R2V、FLF2V) | 使用带 ByteDance Create Image/Video Asset 节点的 Seedance 2.0 真人支持工作流 |

AI 生成肖像

真人肖像

使用真人出镜素材时,请走 真人支持 工作流(须包含 ByteDance Create Image/Video Asset 节点):真人肖像需要一次活体验证,用于防止冒用与未经授权使用他人肖像,并符合相关 AI 透明度监管要求。 首次使用(必须完成核验)- 用 ByteDance Create Image/Video Asset 节点上传人像。

- 运行工作流,得到验证链接。

- 在手机或浏览器中打开链接,完成活体检测(通常约 30 秒内)。

- 核验通过后获得两个 ID:

- Group ID — 代表已通过验证的这一位本人;后续上传同一人时请保留。

- Asset ID — 绑定当前这张人像,可直接接入视频生成,多次运行也可复用。

- 上传该真人的新的照片或视频。

- 在 ByteDance Create Image/Video Asset 节点中填入已保存的 Group ID。

- 系统会比对新上传的人脸与首次核验记录;确认为同一人后,新素材会自动激活可用。

Seedance 2.0 真人支持

查看完整图文步骤、核验流程与真人工作流模板。