Seedance 2.0はByteDanceが提供する次世代マルチモーダル動画生成モデルで、ComfyUI内で利用可能です。テキスト、画像、動画、音声を統一された入力として受け取り、同期音声、一貫したキャラクター、映画的なカメラワークを備えた高品質動画をワンパスで生成します。Documentation Index

Fetch the complete documentation index at: https://dripart-mintlify-e28287af.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

主な機能

- マルチモーダル入力 — テキスト + 画像/動画/音声

- 音声同期 — 映像と音声を同時生成

- カメラ制御 — カメラワークとテンポを演出

- 一貫性 — キャラクターとシーンが安定

- 編集・拡張 — 既存映像の編集やクリップ延長

利用可能なワークフロー

テキストから動画(T2V)

テキストプロンプトだけで動画を生成します。Seedance 2.0がシーン、モーション、テンポをまとめて構成します。クラウドでT2Vを実行

Comfy CloudですぐにText-to-Videoワークフローを試せます。

T2Vワークフローをダウンロード

ワークフローJSONをダウンロードします。

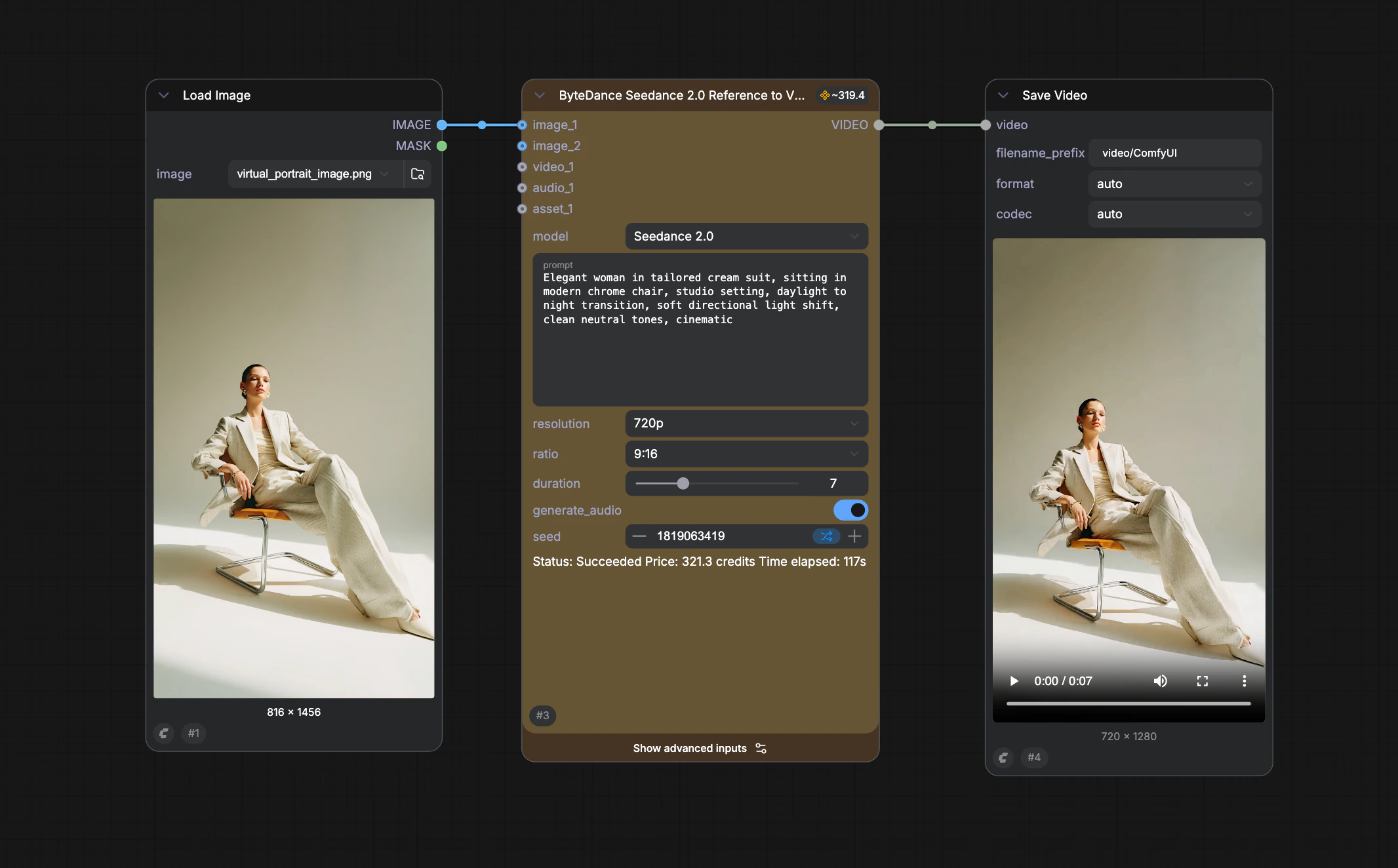

リファレンスから動画(R2V)

参照画像、参照動画、または参照音声を使って、見た目・動き・リズムをガイドしつつ、一貫した結果を生成します。クラウドでR2Vを実行

Comfy CloudですぐにReference-to-Videoワークフローを試せます。

R2Vワークフローをダウンロード

ワークフローJSONをダウンロードします。

最初と最後のフレームから動画(FLF2V)

開始フレームと終了フレームを指定し、その間のモーションと遷移をSeedance 2.0が生成します。クラウドでFLF2Vを実行

Comfy CloudですぐにFirst-Last-Frame-to-Videoワークフローを試せます。

FLF2Vワークフローをダウンロード

ワークフローJSONをダウンロードします。

ComfyUI で実在人物ポートレートと AI 生成ポートレートを使った Seedance 2.0 動画生成

Seedance 2.0 は 実在人物のポートレート(実際の人物の肖像・写真・映像など)と AI 生成ポートレート(AI が合成した画面上のキャラクターであり、特定の実在自然人に対応しないもの)を、人物参照として 同時に サポートします。どちらを選ぶかで、ByteDance 側のライブネスおよび本人確認の要否が変わります。| AI 生成ポートレート | 実在人物ポートレート | |

|---|---|---|

| 指すもの | 画面主体が AI で合成されたキャラクターであり、実在の特定自然人へ対応する必要がない | 実在する人物の肖像・写真・映像などを素材として使う |

| 本人確認 | 追加の検証なし | ByteDance Create Image/Video Asset を経由した ByteDance のライブネス確認(1 回)が必要 |

| ワークフロー | 標準の Seedance 2.0 ワークフロー(T2V、R2V、FLF2V) | ByteDance Create Image/Video Asset ノードを使う Seedance 2.0 実在人物ワークフロー |

AI 生成ポートレート

実在人物ポートレート

実在人物ワークフロー(ByteDance Create Image/Video Asset の利用が必須)を使います。実在肖像には一度ライブネス確認が必要で、なりすましや無断の肖像利用を防ぎ、関連する AI 透明性規制に対応するためです。 初めて使うとき(本人確認が必須)- ByteDance Create Image/Video Asset で肖像画像をアップロードします。

- ワークフローを実行すると確認用リンクが生成されます。

- スマートフォンまたはブラウザでリンクを開き、ライブネス確認を完了します(通常 30 秒程度以内)。

- 確認が通ると 2 つの ID が返ります。

- Group ID — 本人確認済みの人物です。同一人物で再アップロードするときは保存してください。

- Asset ID — この肖像を指します。動画生成に接続でき、複数回の実行でも再利用できます。

- 同一人物の新しい写真または動画をアップロードします。

- ByteDance Create Image/Video Asset に保存済みの Group ID を入力します。

- 新しい顔情報を初回の本人確認記録と突き合わせ、同一人物と判定されると新しいアセットが自動で有効化されます。

Seedance 2.0 実在人物

図解つきの手順、本人確認フロー、および実在人物向けワークフローテンプレートを参照できます。