class StabilityStableImageSD_3_5Node:

"""

Generates images synchronously based on prompt and resolution.

"""

RETURN_TYPES = (IO.IMAGE,)

DESCRIPTION = cleandoc(__doc__ or "") # Handle potential None value

FUNCTION = "api_call"

API_NODE = True

CATEGORY = "api node/image/Stability AI"

@classmethod

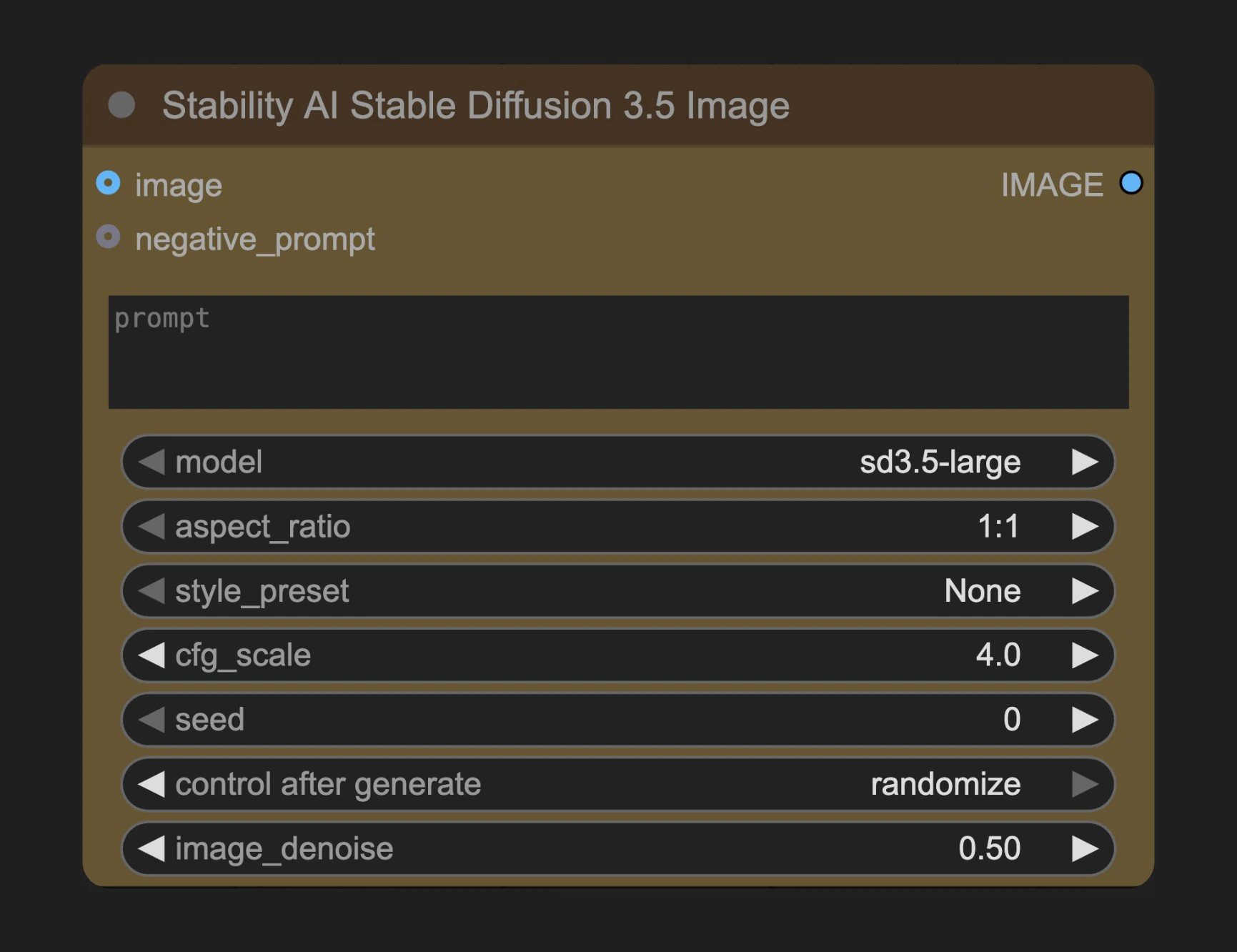

def INPUT_TYPES(s):

return {

"required": {

"prompt": (

IO.STRING,

{

"multiline": True,

"default": "",

"tooltip": "What you wish to see in the output image. A strong, descriptive prompt that clearly defines elements, colors, and subjects will lead to better results."

},

),

"model": ([x.value for x in Stability_SD3_5_Model],),

"aspect_ratio": ([x.value for x in StabilityAspectRatio],

{

"default": StabilityAspectRatio.ratio_1_1,

"tooltip": "Aspect ratio of generated image.",

},

),

"style_preset": (get_stability_style_presets(),

{

"tooltip": "Optional desired style of generated image.",

},

),

"cfg_scale": (

IO.FLOAT,

{

"default": 4.0,

"min": 1.0,

"max": 10.0,

"step": 0.1,

"tooltip": "How strictly the diffusion process adheres to the prompt text (higher values keep your image closer to your prompt)",

},

),

"seed": (

IO.INT,

{

"default": 0,

"min": 0,

"max": 4294967294,

"control_after_generate": True,

"tooltip": "The random seed used for creating the noise.",

},

),

},

"optional": {

"image": (IO.IMAGE,),

"negative_prompt": (

IO.STRING,

{

"default": "",

"forceInput": True,

"tooltip": "Keywords of what you do not wish to see in the output image. This is an advanced feature."

},

),

"image_denoise": (

IO.FLOAT,

{

"default": 0.5,

"min": 0.0,

"max": 1.0,

"step": 0.01,

"tooltip": "Denoise of input image; 0.0 yields image identical to input, 1.0 is as if no image was provided at all.",

},

),

},

"hidden": {

"auth_token": "AUTH_TOKEN_COMFY_ORG",

},

}

def api_call(self, model: str, prompt: str, aspect_ratio: str, style_preset: str, seed: int, cfg_scale: float,

negative_prompt: str=None, image: torch.Tensor = None, image_denoise: float=None,

auth_token=None):

validate_string(prompt, strip_whitespace=False)

# prepare image binary if image present

image_binary = None

mode = Stability_SD3_5_GenerationMode.text_to_image

if image is not None:

image_binary = tensor_to_bytesio(image, total_pixels=1504*1504).read()

mode = Stability_SD3_5_GenerationMode.image_to_image

aspect_ratio = None

else:

image_denoise = None

if not negative_prompt:

negative_prompt = None

if style_preset == "None":

style_preset = None

files = {

"image": image_binary

}

operation = SynchronousOperation(

endpoint=ApiEndpoint(

path="/proxy/stability/v2beta/stable-image/generate/sd3",

method=HttpMethod.POST,

request_model=StabilityStable3_5Request,

response_model=StabilityStableUltraResponse,

),

request=StabilityStable3_5Request(

prompt=prompt,

negative_prompt=negative_prompt,

aspect_ratio=aspect_ratio,

seed=seed,

strength=image_denoise,

style_preset=style_preset,

cfg_scale=cfg_scale,

model=model,

mode=mode,

),

files=files,

content_type="multipart/form-data",

auth_token=auth_token,

)

response_api = operation.execute()

if response_api.finish_reason != "SUCCESS":

raise Exception(f"Stable Diffusion 3.5 Image generation failed: {response_api.finish_reason}.")

image_data = base64.b64decode(response_api.image)

returned_image = bytesio_to_image_tensor(BytesIO(image_data))

return (returned_image,)